انقلاب هوش مصنوعی: چگونه معماری کامپیوترهای جهان را دگرگون کرد؟

هوش مصنوعی نهتنها نرمافزارها، بلکه سختافزارهای جهان را متحول کرده است. از ابررایانههای مبتنی بر کارتهای گرافیکی تا مراکز داده پرمصرف، این فناوری در حال بازنویسی قوانین صنعت محاسبات است.

در طول تاریخ، نوآوریهای فناورانه معدودی بودهاند که توانستهاند تحولی بنیادین در ساختار جهان و صنایع مختلف ایجاد کنند. همانطور که انقلاب صنعتی نقشی ماندگار در شکلگیری دنیای امروز داشت، اکنون نیز هوش مصنوعی در حال رقم زدن انقلابی تازه در حوزه فناوری است؛ انقلابی که فراتر از سطح کاربران معمولی، زیرساختهای اصلی دنیای دیجیتال، از جمله پایگاههای داده و مراکز پردازشی را دگرگون میسازد.

بازتعریف زیرساختها با محوریت هوش مصنوعی

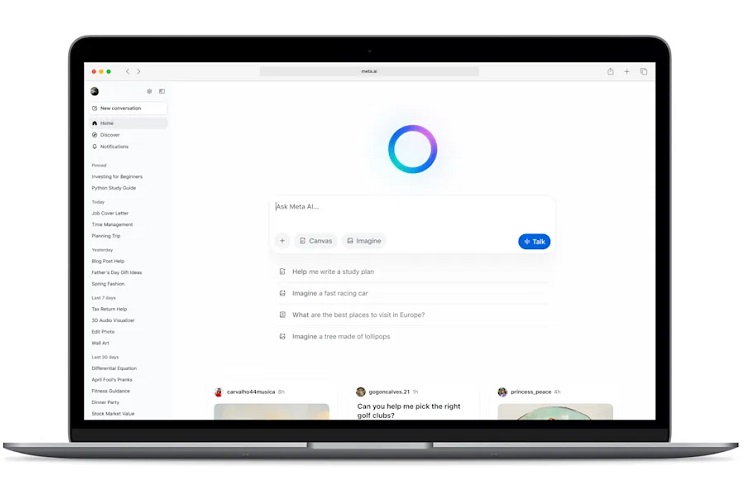

از زمان ظهور اینترنت در دهه ۱۳۷۰ خورشیدی (۱۹۹۰ میلادی)، کامپیوترها و نحوه تعامل ما با آنها دچار تحولات شگرفی شدند. اکنون، فناوری هوش مصنوعی در حال دگرگون کردن فرآیند طراحی و ساخت کامپیوترهای هوشمند در سطح جهانی است. شرکتهای فناوری، همزمان در دو جبهه مشغول رقابتاند: برخی در حال توسعه مدلهایی هستند که کاربران نهایی بتوانند از آنها بهرهبرداری کنند و گروهی دیگر، زیرساختهایی را برای پاسخ به نیازهای سنگین محاسباتی مدلهای هوش مصنوعی فراهم میآورند.

نقش کلیدی کارتهای گرافیک در این تحول

مرکز داده یا «دیتاسنتر» مفهومی آشنا برای فعالان فناوری است. این مراکز که ابتدا برای پاسخ به نیازهای ذخیرهسازی و انتقال داده در بستر اینترنت شکل گرفتند، اکنون بهطور کامل در حال بازطراحی برای پشتیبانی از سیستمهای هوش مصنوعی هستند.

کارتهای گرافیک بهعنوان واحدهایی با توان محاسباتی بالا، هسته اصلی این بازطراحی به شمار میروند. برخلاف پردازندههای سنتی (CPU) که پردازش را بهصورت ترتیبی انجام میدهند، کارتهای گرافیک قادرند دادهها را بهصورت همزمان و موازی پردازش کنند. این ویژگی باعث شده است که امروزه ابررایانههایی با بیش از یکصد هزار کارت گرافیک، ستون فقرات مراکز داده هوش مصنوعی را تشکیل دهند.

از صنعت بازی تا آموزش مدلهای هوشمند

در گذشته، استفاده از کارتهای گرافیک بیشتر محدود به صنایع رسانهای و بازیهای رایانهای بود. اما با کشف توانایی این کارتها در استخراج رمزارز و اجرای مدلهای هوش مصنوعی، تقاضا برای آنها بهطور چشمگیری افزایش یافت. این تغییر باعث شد تا شرکتها به ساخت ابررایانههایی متشکل از هزاران کارت گرافیک روی آورند؛ راهکاری که البته هزینههای هنگفتی نیز در پی داشته است.

برای نمونه، در حالی که نخستین مرکز داده گوگل در سال ۲۰۰۶ میلادی با هزینهای حدود ۶۰۰ میلیون دلار راهاندازی شد، شرکت OpenAI و شرکای آن اکنون در حال برنامهریزی برای ساخت مجموعهای از مراکز داده هوش مصنوعی با برآورد هزینهای بالغ بر ۵۰۰ میلیارد دلار هستند.

چالشهای گسترده انرژی و خنکسازی

مراکز داده هوش مصنوعی علاوه بر هزینهبر بودن، مصرف انرژی بالایی نیز دارند. کارتهای گرافیک در حین پردازش، حرارت زیادی تولید میکنند و همین امر نیاز به سامانههای خنککننده تخصصی را بهوجود آورده است. برخی شرکتها مانند گوگل از سامانههای خنکسازی آبی با گردش مایع خنککننده در مجاورت تراشهها استفاده میکنند؛ روشی که علاوه بر اثربخشی، مصرف منابع آبی را نیز بهشدت افزایش داده است.

برای نمونه، در سال ۲۰۲۳ میلادی مراکز داده گوگل بالغ بر ۶.۱ میلیارد گالن آب مصرف کردند. چنین ارقامی فشار زیادی بر منابع طبیعی وارد کرده و مسئله پایداری زیستمحیطی این مراکز را به یک دغدغه جدی بدل کرده است.

انرژی بیشتر، گرمای بیشتر، دغدغههای بیشتر

افزایش مصرف برق توسط این مراکز نهتنها بر محیط زیست تأثیرگذار است، بلکه زیرساختهای شهری و منطقهای را نیز تحت فشار قرار میدهد. بهعنوان مثال، یک شرکت فعال در زمینه هوش مصنوعی تنها با نصب ده ردیف کامپیوتر مجهز به کارتهای گرافیک، همان میزان برقی را مصرف میکند که پیشتر توسط هشتاد ردیف کامپیوتر سنتی مصرف میشد.

پیشبینیها نشان میدهد مراکز داده هوش مصنوعی در آیندهای نزدیک بیش از چهار درصد از کل انرژی تولیدشده در ایالات متحده را مصرف خواهند کرد.

آینده چیست؟ از کامپیوترهای کوانتومی تا تراشههای سبکتر

در تلاش برای کنترل مصرف انرژی و بهینهسازی عملکرد، شرکتهایی چون گوگل و انویدیا در حال توسعه نسل جدیدی از تراشهها هستند که با بهرهگیری از معماری نورومورفیک، بتوانند کارایی بالاتری در اجرای مدلهای هوش مصنوعی ارائه دهند. در کنار این تلاشها، مفاهیمی مانند کامپیوترهای کوانتومی یا مدلهای هوش مصنوعی کممصرفتر نیز بهعنوان راهکارهای احتمالی مطرح شدهاند.

کلام پایانی

هرچند شرکتهایی مانند DeepSeek موفق شدهاند بدون صرف هزینههای هنگفت، مدلهای هوش مصنوعی مؤثری ارائه دهند، اما برای اکثریت بازیگران این عرصه، ساخت و نگهداری مراکز داده قدرتمند و کارآمد همچنان یک ضرورت است.

اگر صنعت هوش مصنوعی نتواند پاسخی برای چالشهای فعلی، بهویژه در حوزه انرژی و محیط زیست بیابد، تأثیرات منفی آن نهتنها بر فضای فناوری، بلکه بر زندگی روزمره انسانها نیز گستردهتر خواهد شد. آینده از آنِ راهکارهایی خواهد بود که بتوانند تعادل بین پیشرفت فناوری و پایداری منابع را حفظ کنند.