اپل امروز کنفرانس توسعه دهندگان ۲۰۲۴ خود غافلگیریهای زیادی برای علاقهمندان داشت که سرخط اصلی آن ادغام هوش مصنوعی در محصولات این شرکت تحت عنوان سیستم اپل اینتلیجنس(Apple Intelligence) بود.

کنفرانس توسعه دهندگان اپل ۲۰۲۴(WWDC ۲۰۲۴) شب گذشته به صورت رسمی آغاز شد و سخنرانی آغازین آن بسیاری از انتظارات کاربران را برآورده کرد و از بسیاری از بهروزرسانیهای نرمافزاری پردهبرداری کرد. تغییرات بزرگی که در iOS ۱۸ ، macOS Sequoia و watchOS ۱۱ ایجاد میشود که شامل پشتیبانی از RCS، یک برنامه رمزهای عبور جدید، یک برنامه ماشین حساب اصلاحشده برای آیفون و آیپد و مجموعهای از ادغامهای هوش مصنوعی در سراسر محصولات اپل به لطف سامانه «هوش اپل» یا Apple Intelligence است.

در ادامه به معرفی همه چیزهایی که در کنفرانس توسعه دهندگان اپل ۲۰۲۴ اعلام شده است میپردازیم.

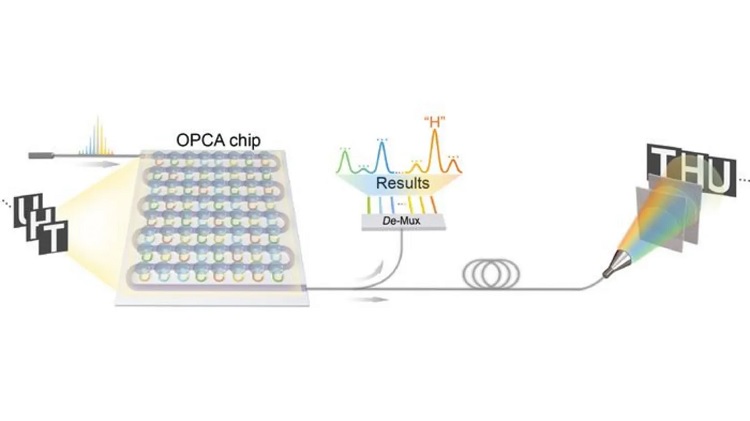

هوش اپل

اپل امسال در کنفرانس توسعه دهندگان خود برنامههای خود را برای گنجاندن هوش مصنوعی در سیستم عاملهای خود فاش کرد. این سیستم هوش مصنوعی مولد جدید که «هوش اپل» نامیده میشود، در iOS و iPad ۱۸ و macOS Sequoia در قالب ابزارهای عملی ظاهر میشود که اکثر مردم میتوانند به طور منظم از آن استفاده کنند.

این ویژگیها شامل ابزارهای نوشتاری جدید است که میتواند به شما در بازنویسی، تصحیح و خلاصه کردن مواردی مانند ایمیلها و پیامهای دیگر، ایموجیها یا شکلکهای اصلی و ایجاد تصویر و موارد دیگر کمک کند.

این ویژگی جدید به نام جیموجی(Gemoji) شامل ابزار تولید تصویر است که به کاربران اجازه میدهد با نوشتن توضیحات درباره آنچه میخواهند ظاهر شود، ایموجیهای منحصر به فرد خود را ایجاد کنند.

سیری

سیری(دستیار هوشمند اپل) نیز اکنون از هوش مصنوعی بهره میبرد که بخشی از آن توسط مدلهای زبان بزرگ تامین میشود. اکنون علاوه بر درخواست از سیری برای حذف ایمیل یا ویرایش عکسها، کاربران همچنین میتوانند از این دستیار مجازی بخواهند مقالات و صفحات وب را در سافاری(مرورگر مخصوص اپل) خلاصه کند و حتی اطلاعات شخصی را از تصویر یک شناسه استخراج کند تا بتواند یک پرسشنامه آنلاین را پر کند.

این شرکت بر اهمیت «حریم خصوصی» با هوش اپل تأکید کرد که مواردی مانند استفاده از زبان طبیعی را برای جستجوی عکسهایی که فقط شامل اعضای خانواده یا دوستان خاص هستند را قادر میسازد.

اپل نشان داد که چگونه اکثر اقدامات هوش اپل بر روی دستگاه انجام میشود تا سیستم تا حد امکان بر حفظ حریم خصوصی متمرکز شود. برای درخواستهایی که نمیتوانند به صورت محلی انجام شوند، وظیفه به مراکز پردازش اپل ارسال میشود.

این شرکت همچنین فضای ابری رایانش مخصوص خود را تحت عنوان Private Cloud Compute ایجاد کرد، قابلیتی که قرار است از فضای ابری برای پردازش پیشرفتهتر هوش مصنوعی استفاده کند و در عین حال اطمینان ایجاد کند که دادههای کاربران ایمن باقی میمانند.

گفتنی است که چت بات مشهور ChatGPT ساخته شرکت اوپنایآی(OpenAI) نیز در هوش اپل ادغام شده است و به کاربران اجازه میدهد تا به اپل اجازه دهند درخواستها را با ChatGPT به اشتراک بگذارد.

مثالهای ارائه شده عبارتند از درخواست ایدههای آشپزی که حاوی مواد خاصی است یا درخواست مشاوره دکوراسیون در حین ارائه یک عکس از فضایی که نیاز به تغییر دکوراسیون دارد.

چتبات ChatGPT همچنین با ابزارهای نوشتن هوش مصنوعی که برای iOS ۱۸ و iPadOS ۱۸ در یک ویژگی جدید به نام Compose عرضه میشوند، کار خواهد کرد.

ادغام ChatGPT با iOS ۱۸، iPadOS ۱۸ و macOS Sequoia اواخر امسال عرضه خواهد شد و ظاهراً اپل قصد دارد در آینده از سایر مدلهای هوش مصنوعی نیز پشتیبانی کند، به این معنی که مشارکت آن با شرکت اوپنایآی یک همکاری انحصاری و طولانی مدت نیست.

سیستمهای عامل iOS ۱۸ و iPadOS ۱۸

بهروزرسانی نرمافزار بعدی گوشیهای آیفون در پاییز برای کاربران عرضه میشود و همانطور که انتظار میرود، یکی از بزرگترین تغییرات، پشتیبانی از Rich Communication Service یا RCS است که یک پروتکل پیامرسانی ایمنتر است و پیشرفتهای زیادی را از جمله رمزگذاری سراسری، اشتراکگذاری رسانه بهتر و پشتیبانی مناسب از چتهای گروهی نسبت به پیامک(SMS) ارائه میدهد.

شرکت اپل قبلاً اعلام کرده بود که در سال ۲۰۲۴ از RCS پشتیبانی میکند تا با مقررات اتحادیه اروپا مطابقت داشته باشد.

همچنین قابلیت جدیدی در پیامرسانی به نام «تپبک»(tapback) امکان پاسخ با استفاده از ایموجیها و استیکرها، قالببندی متن و افکتها و امکان ارسال پیام از طریق ماهواره را فراهم خواهد کرد.

کاربران آیفون در iOS ۱۸ کنترل بیشتری روی صفحه اصلی خود خواهند داشت، زیرا دیگر سیستم آن قفل شده و از پیش تعیین شده و غیر قابل تغییر نخواهد بود. اکنون کاربران میتوانند آیکونهای برنامهها را به روشی آزادانهتر جابجا کنند، به علاوه میتوانند رنگ نماد برنامه را نیز تغییر دهند.

از نظر طراحی و چیدمان، این یکی از بزرگترین تغییراتی است که در سالهای اخیر در صفحه اصلی آیفون ایجاد شده است و به کاربران iOS ویژگیهای مشابهی را میدهد که کاربران اندرویدی برای مدت طولانی در اختیار داشتهاند.

در همین راستا، مرکز کنترل(Control Center) نیز در iOS ۱۸ بهروزرسانی میشود تا گزینههای سفارشیسازی بیشتری را شامل شود و به کاربران اجازه میدهد تا علاوه بر گزینههای پیشین، کنترلهای سریع را از برنامههای شخص ثالث در آن جای دهند.

برنامه عکسها(Photos) نیز در iOS ۱۸ بازطراحی بزرگی را دریافت میکند و بر گروههایی از عکسها که به طور هوشمند سازماندهی شدهاند که حول خاطرات، سفرها و سایر رویدادهای بزرگ میچرخند، تاکید دارد. این طرح جدید طرحبندی، روشهای قدیمی را حذف میکند و میتوانید همه عکسهای خود را بهصورت جداگانه مشاهده کنید یا آنها را به صورت مجموعهای مشاهده کنید.

کاربران همچنین میتوانند مواردی مانند اسکرینشاتها و رسیدهایی را که در قالب زمانی نمایش داده میشوند، فیلتر کنند.

چند ویژگی جدید حفظ حریم خصوصی در iOS ۱۸ برجسته است که شامل توانایی قفل کردن و مخفی کردن برنامههاست. در مورد اول، کاربران میتوانند برنامهای را قفل کنند تا اطلاعات حساس در پشت دیوار Face-ID یا Touch-ID باقی بماند و حتی کسانی را که به طور اتفاقی آیفون خود را به آنها میدهید، نتوانند آن اطلاعات را ببینند. در مورد دومی نیز مخفی کردن یک برنامه، آن را در یک پوشه مخفی خاص پنهان میکند که دیگران قادر به دیدن آن نیستند.

برنامه ماشین حساب(Calculator) هم در iOS ۱۸ دچار تغییرات اساسی شده است. از جمله تبدیل واحدهای بهبود یافته، نوار کناری که فعالیت اخیر و ادغام با برنامه یادداشت(Notes) را نشان میدهد.

آنچه که میتواند حتی قابل توجهتر باشد این واقعیت است که برنامه اصلاح شده ماشین حساب اپل نه تنها در آیفونها و مکها در دسترس خواهد بود، بلکه برای اولین بار به عنوان بخشی از بهروزرسانی iPadOS ۱۸ به آیپد نیز میآید.

همچنین ویژگی جدیدی به نام یادداشت های ریاضی(Math Notes) در برنامه ماشین حساب آیپد تعبیه شده است که به کاربران امکان میدهد معادلات ریاضی را با قلم اپل(Apple Pencil) بنویسند و برنامه آن معادلات را فوری حل کند.

سیستم عامل iPadOS ۱۸ همچنین دارای نوار Tab جدید است که شبیه جزیره دینامیک در آیفونهاست. این نوار، دسترسی به کنترلهای ضروری را حتی زمانی که در برنامهها هستید آسانتر میکند و بسته به کاری که انجام میدهید، میتواند در بالای صفحه یا به عنوان یک نوار کناری در سمت چپ نمایشگر نشان داده شود.

همچنین برنامه Notes در iPadOS یک ویژگی جدید دیگر به نام Smart Script دریافت میکند که باعث میشود دستخط کاربران به طور خودکار خواناتر و کمتر شلوغ باشد.

مکاواس سکویا

نسخه جدید نرم افزار کامپیوتر اپل مکاواس سکویا(macOS Sequoia) نام دارد که علاوه بر بسیاری از ویژگیهای هوش مصنوعی که به عنوان بخشی از «هوش اپل» به iOS و iPadOS ۱۸ میآیند، بهروزرسانی بعدی macOS شامل آینهکردن(mirroring) آیفون میشود که به کاربران اجازه میدهد صفحه آیفون خود را روی صفحه Mac ببینند و کنترل کنند. کاربران میتوانند از صفحهکلید خود برای کمتر کار کردن با صفحه آیفون استفاده کنند و حتی میتوانند برنامههای iOS را مستقیماً روی رایانهشان باز کنند، بدون اینکه نیاز باشد آیفون خود را بردارند.

یک برنامه جدید رمز(Passwords) نیز بر اساس فناوری iCloud keychain ساخته شده است تا همه گذرواژهها و اعتبارنامههای ورود کاربران را در دستگاهها و پلتفرمها ذخیره کند. این ویژگی علاوه بر iOS و iPadOS در ویندوز نیز در دسترس خواهد بود.

این برنامه جدید همراه با گذرواژههای استاندارد میتواند کلیدهای عبور، کدهای تأیید و موارد دیگر را ذخیره کند و به کاربران این امکان را بدهد که به طور امن رمز عبور را با دیگران به اشتراک بگذارند.

دیگر بهروزرسانیهایی که در macOS Sequoia ارائه میشوند عبارتند از ابزار چیدمان پنجره فوری با میانبرهای صفحه کلید و منو و یک ویژگی به نام Presenter Preview که به شما امکان میدهد آنچه را که میخواهید با کسانی با آنها در حال صحبت کردن تلفنی هستید، به اشتراک بگذارید، قبل از دیدن آنها ببینید.

کاربران همچنین به ویژگی Image Playground در macOS Sequoia که مولد تصویر هوش مصنوعی اپل است که در هوش اپل تعبیه شده است، دسترسی خواهند داشت. این ویژگی توانایی ایجاد تصاویر تولید شده با هوش مصنوعی در سبکهای مختلف از جمله پویانمایی، تصویرسازی و طراحی را فراهم میکند.

سیستم عامل جدید ساعت هوشمند اپل

بهروزرسانی نرمافزاری بعدی اپل برای ساعت هوشمند این شرکت موسوم به اپل واچ(Apple Watch) شامل دو تغییر بزرگ به نامهای بار تمرین(Training Load) و علائم حیاتی(Vitals) است که اولی در watchOS ۱۱ اساساً از بسیاری از معیارهای سلامت و تناسب اندام جمعآوری شده در طول ردیابی تمرین ورزشی برای تخمین سطح تلاش کاربر در هر جلسه استفاده میکند. بدین صورت که هر تمرین، امتیازی از یک(آسان) تا ۱۰(سخت) دریافت میکند که میزان سختی تمرین کاربر را در آن جلسه خاص تخمین میزند.

برنامه جدید Vitals نیز به کاربران اپل واچ نشان میدهد که علائم حیاتی آنها از جمله ضربان قلب در مقایسه با اندازهگیریهای پایه و استاندارد چگونه ثبت شده است. این ویژگی به کاربران امکان میدهد بهتر بفهمند چه زمانی چیزی غیر عادی پیش میرود و از محدوده عادی خارج میشود.

اپلیکیشن فعالیت(Activity) در آیفون نیز در حال دریافت بهروزرسانی به همراه watchOS ۱۱ است و به کاربران امکان میدهد دادههایی را که در صفحه اصلی میبینند، شخصیسازی کنند تا بتوانند مهمترین آمارها را پیش روی خود ببینند.

ردیابی قاعدگی برای بانوان نیز بهروزرسانیهایی دریافت میکند که شامل اطلاعات دقیقتری درباره بارداری، از جمله سن حاملگی و اطلاعاتی درباره معیارهای سلامتی کاربر مانند نوسانات ضربان قلب است که ممکن است با بارداری مرتبط باشد.

سیستم عامل visionOS ۲

تاکنون هدست واقعیت ترکیبی شرکت اپل به نام ویژن پرو(Vision Pro) تنها در ایالات متحده در دسترس بوده است، اما این موضوع به زودی تغییر میکند، زیرا این شرکت اعلام کرد که این دستگاه در کشورهای دیگری از جمله استرالیا، کانادا، چین، فرانسه، آلمان، ژاپن، سنگاپور و بریتانیا طی ماههای آینده عرضه خواهد شد.

در مورد نرمافزار این هدست نیز که «ویژن اواس»(visionOS) نام دارد، اپل اعلام کرد که عکسهای فضایی(spatial photos) را به آن اضافه میکند که به تصاویر در برنامه Photos عمق میبخشد و کنترلهای حرکتی رابط کاربری جدید و بهبود آینه کردن روی صفحه مک با پشتیبانی از وضوح و اندازههای نمایش بالاتر را ارائه میدهد.

بهروزرسانیهای صوتی ایرپادز پرو

اپل به طور خلاصه به برخی از بهروزرسانیهای نرمافزاری که برای AirPods Pro میآیند، از جمله بهبود ایزوله کردن صدا(Voice Isolation) اشاره کرد که به ایرپادها کمک میکند تا صدای کاربر را در محیطهای شلوغ بهتر دریافت کنند.

همچنین یک ویژگی جدید موسوم به تعامل سیری(Siri Interaction) به ایرپادز پرو میآید که با یک سر تکان دادن بیصدا به کاربران اجازه میدهد بدون نیاز به گفتن هر کلمهای به سیری، به تماسهای دریافتی پاسخ دهند و همچینن با تکان دادن سر بتوانند یک تماس ورودی را رد کنند. این تعاملات بیصدا برای پیامها و اعلانها نیز قابل اجرا خواهد بود.

+ نوشته شده در چهارشنبه بیست و سوم خرداد ۱۴۰۳ ساعت 6:34 توسط شهرام

|